TRO 2023|iSimLoc:利用虚拟图像对未看到的环境进行视觉全局定位

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

点击预约直播,开播第一时间进场

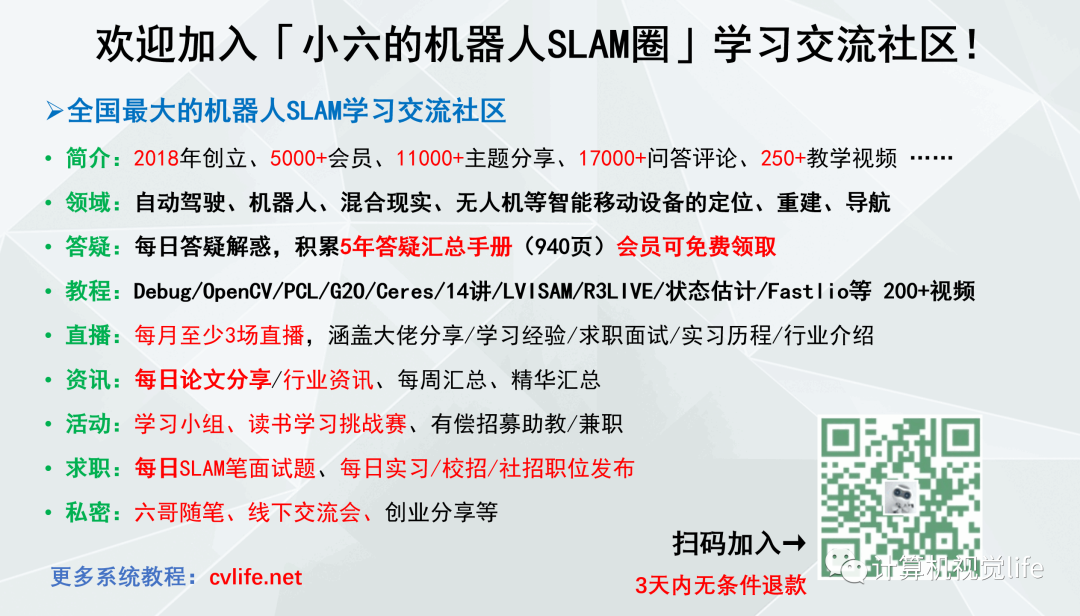

小六的机器人SLAM圈】,在这里你可以收获:星主答疑解惑/定期直播分享/最新招聘信息/笔面试题速递/行业最新动态/每日领域论文翻译/成员定期交流活动

还有星球专属视频哦~(图片篇幅有限,更多内容请移步官网cvlife.net查看~)

点击领取学习资料 → 机器人SLAM学习资料大礼包

#论文##开源# TRO 2023|iSimLoc:利用虚拟图像对未看到的环境进行视觉全局定位

【iSimLoc: Visual Global Localization for Previously Unseen Environments With Simulated Images】

作者单位:卡耐基梅隆大学与加州大学圣地亚哥分校

开源代码:GitHub: Let’s build from here · GitHub MetaSLAM/iSimLocServer

文章链接:iSimLoc: Visual Global Localization for Previously...

相机由于体积小、重量轻、功耗低且成本低,是无人机超视距操作的一种有吸引力的设备。但是,目前最先进的视觉定位算法在匹配视觉数据方面存在困难,尤其是在照明或视角产生显著变化时。本文提出了iSimLoc,这是一种基于学习的全局重定位方法,对外观和视角的变化具有鲁棒性。iSimLoc的场景识别网络学习到的特征可以用来匹配查询图像和不同视觉风格域和视角的参考图像。此外,我们的分层全局重定位模块以粗细粒度的方式进行搜索,使iSimLoc可以进行快速精确的姿态估计。

我们在一个外观变化的数据集和一个着重展示复杂地形长时间飞行的大规模匹配的数据集上评估了我们的方法。与下一优方法的45.8%和39.7%相比,iSimLoc在两个数据集上的成功检索率分别为88.7%和83.8%,推理时间为1.5秒。这些结果展示了该方法在各种环境和条件下的强大定位能力。

以上内容来自小六的机器人SLAM学习圈知识星球每日更新内容

如果你还不是【小六的机器人SLAM圈】成员,扫描加入↓“长按”或“扫描”下方二维码,加入即可开始学习~3天内无条件退款~ 购买后务必加客服领取其他权益和加交流群,现在加入免费送近千页5年机器人SLAM答疑手册

最后介绍一下我们最近的几个学习活动:(点击下方标题即可快速获取)

管道内单目视觉SLAM尺度漂移较明显,定位挑战很大。学完本项目,你可以动手做到:利用管道的圆柱形结构约束,基于ORB-SLAM2改进地图点位置估计,从而优化SLAM算法精度。详情点击 从小白到老手,我如何搞定管道机器人位姿估计?LVI-SAM是MIT团队的TixiaoShan等人开源的一个紧耦合的激光雷达视觉惯导SLAM系统,可以实时高精度鲁棒的进行状态估计和建图。哈工大博士带你学习,1个月的学习挑战赛,详情点击 MIT团队开源的这个激光雷达视觉惯导SLAM系统,太香了!FAST-LIO2是香港大学火星实验室(MARS)发表在IEEE-RAL和IEEE-TRO的两篇论文,是一种具有高计算效率、高鲁棒性的雷达惯性里程计(LIO)本课程中上海交通大学博士王泽霖推出为期1个月的学习挑战赛第2期,从原理到实战快速掌握,详情点击 香港大学开源的这个激光雷达惯性SLAM,太强了!本项目对ALOAM进行改进,融合众多新技术,ALOAM+ LINK3D + CSF + BALM,纯激光雷达SLAM效果逼近LIO-SAM。详情点击 我用纯LiDAR SLAM实现逼近LIO-SAM的效果,如何做到?

最后介绍一下我们最近的几个学习活动:(点击下方标题即可快速获取)

关键词

激光雷达

方法

机器人SLAM

数据集

图像

最新评论

推荐文章

作者最新文章

你可能感兴趣的文章

Copyright Disclaimer: The copyright of contents (including texts, images, videos and audios) posted above belong to the User who shared or the third-party website which the User shared from. If you found your copyright have been infringed, please send a DMCA takedown notice to [email protected]. For more detail of the source, please click on the button "Read Original Post" below. For other communications, please send to [email protected].

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。