机器学习(4)之线性判别式(附Python源码)

微信公众号

关键字全网搜索最新排名

【机器学习算法】:排名第一

【机器学习】:排名第二

【Python】:排名第三

【算法】:排名第四

LDA是什么?

线性判别式分析(Linear Discriminant Analysis),简称为LDA。也称为Fisher线性判别(Fisher Linear Discriminant,FLD),是模式识别的经典算法,在1996年由Belhumeur引入模式识别和人工智能领域。

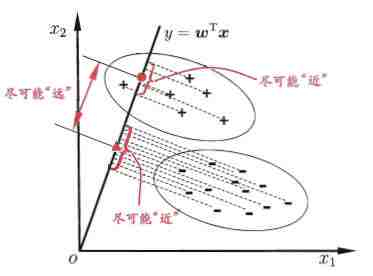

LDA的思想还是很简单的:给定训练样本,设法将样本投影到一条直线或者一张超平面上,使得同类样例点的投影尽可能的接近,异类样本点的投影尽可能远离;在对新的样本点进行分类时,将其投影到上述确定的这条直线上,再根据投影点的位置来确定新样本的类别,如下图所示(为方便可视化,以二维数据为例)

该图来源于《机器学习》

如图所示,可以看到两个类别,一个黑点类别,一个黑×类别。现在要求将数据从二维降维到一维。直接投影到x1轴或者x2轴,不同类别之间会有重复,导致分类效果下降。图中所示直线就是用LDA方法计算得到的,可以看到,黑点类别和黑×类别在映射之后之间的距离是最大的,而且每个类别内部点的离散程度是最小的(或者说聚集程度是最大的)。

LDA数学理论

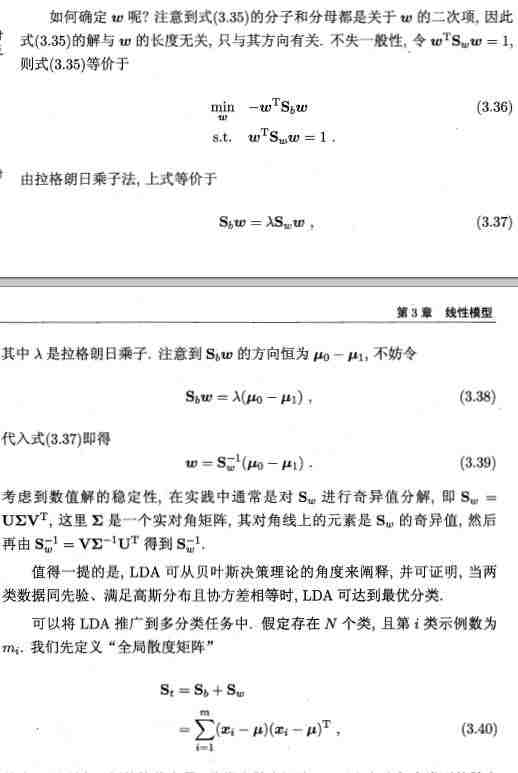

在上一小节我们以语言的形式描述了LDA的原理。并以机器学习中的图为例说明了为什么这种方法在分类时会有比较好的效果。现在,我们从理论上证明这种方法的可行性,并为接下来的算法实现铺垫基础。

在正式推导公式之前我们需要理解两件事情:

1、为了实现投影后的两个类别的距离较远,用映射后两个类别的均值差的绝对值来度量。

2、为了实现投影后,每个类内部数据点比较聚集,用投影后每个类别的方差来度量。

因为在公众号的排版中不能书写公式,我了方便起见,这儿直接以《机器学习》中的内容为主,假如您觉得影响阅读效果的话可以直接参考《机器学习》的第三章第四节或者加入机器学习交流群(429055771,或者扫面文末二维码)下载电子版,有任何问题我们可以一起讨论。

Python实现

源代码下载请在后台回复关键词:LDA,或者加入机器学习交流2群(634808033)在文件区中下载。

参考:

1. 周志华《机器学习》

2. Duanxx的博客:http://blog.csdn.net/daunxx/article/details/51881956

3. 艳光普照的博客:http://blog.csdn.net/szv123_rier/article/details/8766538

4. porly的博客:http://blog.csdn.net/porly/article/details/8020696

招募 志愿者

广告、商业合作

请发邮件:[email protected]

喜欢,别忘关注~

帮助你在AI领域更好的发展,期待与你相遇!

最新评论

推荐文章

作者最新文章

你可能感兴趣的文章

Copyright Disclaimer: The copyright of contents (including texts, images, videos and audios) posted above belong to the User who shared or the third-party website which the User shared from. If you found your copyright have been infringed, please send a DMCA takedown notice to [email protected]. For more detail of the source, please click on the button "Read Original Post" below. For other communications, please send to [email protected].

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。