CVPR 2024 | OmniParser:统一图文解析模型:文字检测识别、视觉信息抽取和表格识别

点击下方卡片,关注“CVer”公众号

点击下方卡片,关注“CVer”公众号

AI/CV重磅干货,第一时间送达

AI/CV重磅干货,第一时间送达

添加微信:CVer5555,小助手会拉你进群!

扫描下方二维码,加入CVer学术星球!可以获得最新顶会/顶刊上的论文idea和CV从入门到精通资料,及最前沿应用!发论文/搞科研/涨薪,强烈推荐!

转载自:CSIG文档图像分析与识别专委会

本文简要介绍CVPR 2024录用论文“OmniParser: A Unified Framework for Text Spotting, Key Information

Extraction and Table Recognition”的主要工作。这篇文章提出了一个新的统一框架,将文字领域的核心任务(文字检测识别,关键信息抽取和表格识别)巧妙融合在一起,无需额外的任务相关的定制化模块设计。

随着深度学习的快速发展,模型可用训练数据规模呈指数级上升,大规模语言模型[1]和多模态模型[2]的通用理解能力得到了巨大的提高,出现了一批能解决多种任务的统一模型[3-5]。

文字图像解析涉及到多种OCR领域核心技术,如文字检测识别,关键信息抽取和表格识别,尽管有部分模型[6-7]尝试仅通过一个模型覆盖多种文字解析任务,但它们通常依赖于外部预先得到的OCR结果或缺乏文字的精确定位能力。SPTS[8]尝试将文字检测识别通过一个序列完成,但由于文字形状复杂多变以及文字内容长短不一,使用一个序列包含这些信息将会导致序列长度过长,极大降低了模型的推理效率。

这篇文章首次提出文字图像的统一解析模型OmniParser,在一个框架内解决多个任务的同时提供了精确的文本位置,模型可解释性大幅提高。同时,OmniParser将OCR基础任务检测识别与结构化序列进行解耦,通过并行化处理检测识别大幅减少了推理时间。

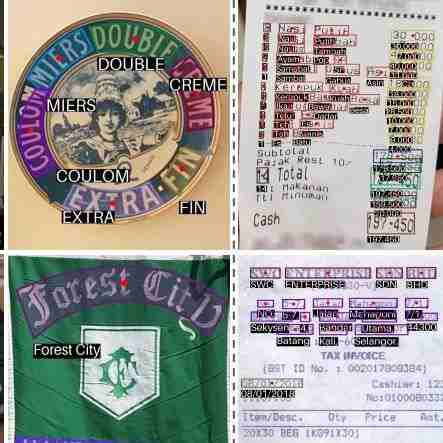

图1 OmniParser多任务输入输出结构形式

OmniParser整体框架如图2所示,模型主要包含图像编码器,结构化中心点序列解码器,检测框解码器以及文本内容解码器。首先,文字图像经过图像编码器得到预处理图像特征;其次,图像特征和任务提示符(用于区分不同任务,如<S_TR>、<S_KIE>、<S_TS>分别表示表格识别、关键信息抽取、文本识别。)一起输入结构化中心点序列解码器,得到任务相关的结构化序列,该结构化序列包含丰富的信息,如表格中的行列结构以及信息抽取中的实体类别;接着,将上一步得到的结构化中心点序列中的中心点和图像特征一起输入到检测框解码器和文本内容解码器,得到中心点对应的文本包围框以及文字识别内容;最后,根据解码后的文字包围框、文本内容以及结构化中心点序列得到最终的图像解析结果。文字包围框以及内容解码可以多个中心点并行处理,同时三个编码器的设计也进一步大幅降低了模型推理时间。

图2 OmniParser整体框架图

作者主要在三个OCR核心任务上验证了OmniParser的先进性,在文字检测识别任务上,OmniParser不仅在常规文字数据集上达到了领先的效果,在曲形文字数据集以及文字行数据集上也超越了之前的方法。

表1 文字检测识别任务上方法效果对比

在关键信息抽取任务上,OmniParser可以同时得到实体的类别信息以及精确的位置信息,在CORD以及SROIE数据集上也取得了比之前方法更好的表现,值得注意的是多数端到端抽取方法无法提供精确的文本定位能力,这削弱了方法的可解释性,部分情况下会出现较为严重的幻觉问题。表3展示了OmniParser在表格识别任务上的性能对比,其不仅可以获得准确的表格结构,同时可以得到单元格的具体位置以及文本内容,通过一次前向处理端到端的得到最终的表格解析结果。

表2 关键信息抽取任务上方法效果对比

表3 表格识别任务上方法效果对比

作者进一步探究了OmniParser在层次化文字检测任务[9]上的表现,如图3所示,从左至右分别为单词、文字行和段落级别的检测粒度,可以看到OmniParser可以准确的区分出不同层次的文字粒度信息,这仅需要针对该任务将结构化中心点序列进行相应的改造适配,模型其他部分并不需要过多改动,即可实现对新任务的高效迁移。

图3 OmniParser在层次化文字检测任务上的部分可视化结果

本文提出了一种面向文字图像的统一解析框架,将OCR多个核心任务进行了形式上的统一,同时展现出对于其他OCR任务如层次化文字检测的泛化能力,对于开发OCR领域的统一大模型又近了一步,未来考虑将解码器替换为更加先进的大规模语言模型,实现更通用的文本理解能力。

论文链接:https://arxiv.org/abs/2403.19128

代码:https://github.com/AlibabaResearch/AdvancedLiterateMachinery

[1] OpenAI. ChatGPT.

https://openai.com/chatgpt, 2023. Accessed: 2023-09-27.

[2] OpenAI. GPT-4V(ision) System Card.

https://cdn.

openai.com/papers/GPTV_System_Card.pdf,

2023. Accessed: 2023-10-09.

[3] Hao Feng, Zijian Wang, Jingqun Tang,

Jinghui Lu, Wengang Zhou, Houqiang Li, and Can Huang. Unidoc: A universal large

multimodal model for simultaneous text detection, recognition, spotting and

understanding.

[4] Teakgyu Hong, Donghyun Kim, Mingi Ji,

Wonseok Hwang, Daehyun Nam, and Sungrae Park. Bros: A pre-trained language

model focusing on text and layout for better key information extraction from

documents. In Proceedings of the AAAI Conference on Artificial Intelligence,

pages 1076710775, 2022.

[5] Xin Li, Yan Zheng, Yiqing Hu, Haoyu Cao,

Yunfei Wu, Deqiang Jiang, Yinsong Liu, and Bo Ren. Relational representation

learning in visually-rich documents. In Proceedings of the 30th ACM

International Conference on Multimedia, pages 4614–4624, 2022.

[6] Geewook Kim, Teakgyu Hong, Moonbin Yim,

JeongYeon Nam, Jinyoung Park, Jinyeong Yim, Wonseok Hwang, Sangdoo Yun,

Dongyoon Han, and Seunghyun Park. Ocr-free document understanding transformer.

In Computer Vision ECCV 2022 - 17th European Conference, Tel Aviv, Israel,

October 23-27, 2022, Proceedings, Part XXVIII, pages 498–517. Springer, 2022.

[7] Haoyu Cao, Changcun Bao, Chaohu Liu,

Huang Chen, Kun Yin, Hao Liu, Yinsong Liu, Deqiang Jiang, and Xing Sun.

Attention where it matters: Rethinking visual document understanding with

selective region concentration. In Proceedings of the IEEE/CVF International

Conference on Computer Vision, pages 19517–19527, 2023.

[8] Dezhi Peng, Xinyu Wang, Yuliang Liu,

Jiaxin Zhang, Mingxin Huang, Songxuan Lai, Jing Li, Shenggao Zhu, Dahua Lin,

Chunhua Shen, et al. Spts: single-point text spotting. In Proceedings of the

30th ACM International Conference on Multimedia, pages 4272–4281, 2022.

[9] Shangbang Long, Siyang Qin, Dmitry

Panteleev, Alessandro Bissacco, Yasuhisa Fujii, and Michalis Raptis. Towards

end-to-end unified scene text detection and layout analysis. In Proceedings of

the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pages

1049–1059, 2022.

原文作者:Jianqiang Wan, Sibo Song, Wenwen Yu, Yuliang Liu, Wenqing Cheng, Fei Huang, Xiang Bai, Cong Yao, Zhibo Yang

撰稿:万建强 编排:高 学

审校:殷 飞 发布:金连文

何恺明在MIT授课的课件PPT下载

CVPR 2024 论文和代码下载

Mamba和扩散模型交流群成立

一定要备注:研究方向+地点+学校/公司+昵称(如Mamba或者扩散模型+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

▲扫码加入星球学习

▲扫码加入星球学习▲点击上方卡片,关注CVer公众号整理不易,请点赞和在看

阅读原文 ▲扫码或加微信号: CVer5555,进交流群

CVer计算机视觉(知识星球)来了!想要了解最新最快最好的CV/DL/AI论文速递、优质实战项目、AI行业前沿、从入门到精通学习教程等资料,欢迎扫描下方二维码,加入CVer计算机视觉(知识星球),已汇集近万人!

▲扫码加入星球学习

▲点击上方卡片,关注CVer公众号

整理不易,请点赞和在看

最新评论

推荐文章

作者最新文章

你可能感兴趣的文章

Copyright Disclaimer: The copyright of contents (including texts, images, videos and audios) posted above belong to the User who shared or the third-party website which the User shared from. If you found your copyright have been infringed, please send a DMCA takedown notice to [email protected]. For more detail of the source, please click on the button "Read Original Post" below. For other communications, please send to [email protected].

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。