Facebook的社会责任感:如何利用人工智能预测以及防止自杀?

平均阅读时长为 2分钟

编译/Anna

原作/Megan Molteni

原文/Wired

Facebook投资人工智能领域已经好些年了。借助于机器学习和深度神经网络,Facebook能够更好地建设其核心广告业务——如今它已经比任何人都会卖东西了。但是这个月早些时候,Facebook决定将它的某些AI技术奉献给更崇高的事业:预防自杀。当然,Facebook这么做并不是完全没有私心的:毕竟有人在Facebook上公开直播自杀对其品牌也是不利的。

不过,并非只有Facebook, Instagram这样的科技巨头,以及来自中国的视频平台新星live.me在研发这类自我伤害标识技术。研究型医院医生们,甚至美国退伍军人事务部,都在开发人工智能驱动的新型自杀预防平台,以便获取比以往更多的数据。人们常说“预防才是最好的治疗”,对于精神健康更是如此。因而这项技术最终的目标便是:利用AI建立起预防机制,以便更早地根据个人情况进行介入自杀。

Live.me app截屏

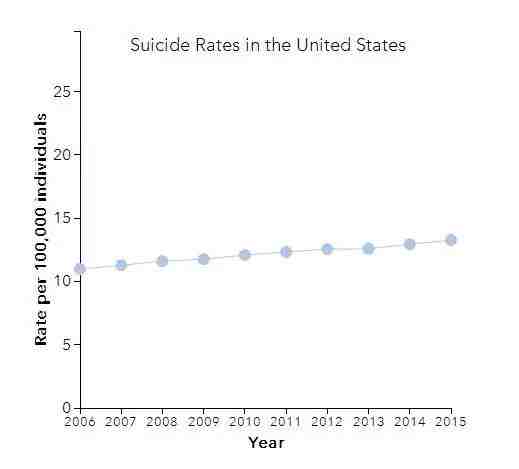

如果你觉得最近听到“自杀”的频率比以往高了,原因恐怕不只是媒体效应。据美国疾病预防控制中心最新数据显示,全国自杀率于2014年达到了近30年最高。历史上,我们采取的预防措施无非是限制接触枪支和危险药物、或者培养医生来识别此类风险。但问题是,50年以来,医生也不过都是根据可能与自杀相关的表现(比如抑郁症和吸毒)来进行判断的。有调查显示,他们能够识别自杀的概率也不过比抛硬币的那50%高上一星半点而已。

美国自杀学协会公布的自杀率数据(2006-2015)

但是人工智能却有可能更准确地识别出人们的自杀倾向、以便人们能在思想变为行动前进行介入。这个月前些时候,佛罗里达州立大学的研究人员就曾发表过一项借助机器学习预测自杀行为的研究。该项目中,人工智能最远能预测到未来两年内人们是否会采取自杀行为,且准确率高达80%至90%。他们获取了田纳西州两百万病人的匿名电子病历,用它们来训练算法,这样算法就能学会根据止痛药处方、入急诊室次数等因素的组合来预测实验对象自杀的可能性。

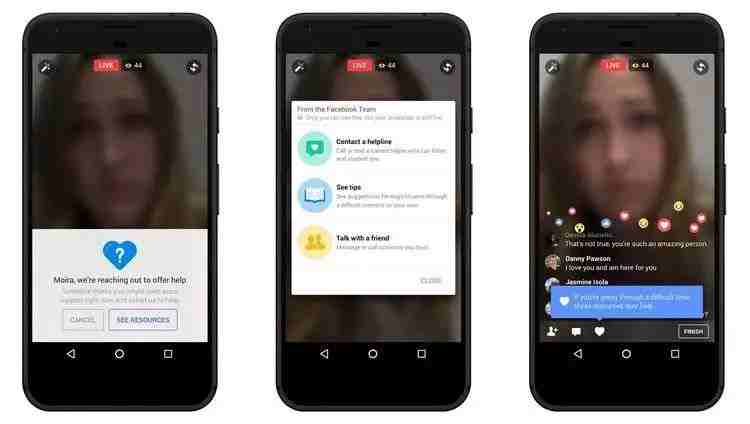

在直播中标记自我伤害倾向流程示意

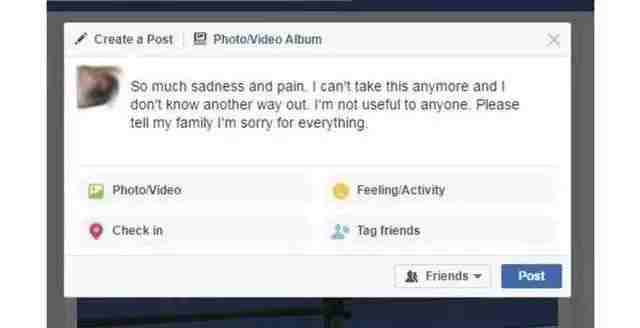

该项目中使用的技术其实和Facebook留言墙上用的技术差不多。Facebook现在其实已经有了一个自杀预防体系:用户如果看到po文显示出自我伤害倾向,可以进行上报;而有了这些上报信息,Facebook就可以训练算法来识别相似的文章。目前这一体系还在美国范围进行测试。一旦算法识别出了一篇文章,其Facebook页面中上报“自杀或自我伤害”的选项就会突出显示。在扎克伯格自己的一篇po文中,他还阐释了自家公司是怎么将其他自杀预防措施(比如从直播视频中进行识别)整合到这一试验体系里的。

一段有自我伤害倾向的po文

接下来一步,就是如何用AI同时分析视频、音频和文章评论的问题了。不过这一步从信息工程的角度来说是相当复杂的。对研究人员来说,他们很清楚一个人在传达自己的痛楚、或者描述自己的情绪状态的时候会说什么。但在直播流媒体中,唯一的文本内容来自于参与评论的人而非直播人自身,因而让人工智识别是非常困难的。仅就视频而言,软件工程师们已经研究出了如何自动识别屏幕中的对象是否裸体,因而他们也能用类似技术探测屏幕中是否有枪支或道具。而识别自杀型药物还要难得多。

先预测,再预防

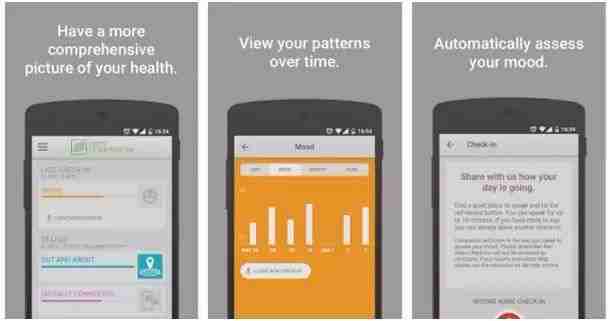

理想化地来看,其实我们还能更早介入。一家叫做Cogito的公司正是通过收集完全不同类型的数据做到了这点。这家公司由美国国防高级研究计划局(DARPA)资助、附属于麻省理工的公司,目前正在测试一款能够仅根据你声音就测绘出精神健康状况的app。这款app名叫companion(同伴)。在使用前,用户可以选择是否参与预测计划。而软件自身会被动地收集用户在一天内说的所有东西、识别出语音中显示出抑郁或者其他情绪变化的信号。Companion分析的并不是语言的内容,而是说话者的语调、精力、表达流畅性以及对话参与程度。它还会利用手机自带的加速度计量仪来识别你的活跃程度,这一点对于抑郁情绪的识别尤为有效。

Companion屏幕截图

目前,美国退伍军人事务部正在数百名老兵中试验这个app。在这一方面,老兵是一个高风险群体(编者注:你还记得《美国狙击手》那部电影吗?)。试验结果得今年底才能出来,但是目前看来companion已经能够识别出诸如失去家人等的重大人生变故。这类变故是会大大提升一个人的自杀风险的,但是除非当事人能自己开口,否则主流医护人员将很难了解到。所幸如今这款软件做到了。

与此同时,David K. Ahern正在在波士顿的布莱汉姆妇科医院领导另一项Companion的运行试验,这次他们的监测对象是一批存在行为障碍的病患。一旦发现安全隐患,app会发出警报信号、提醒医生或社会福利工作人员来检查病人的情况。迄今为止,app还没有怎么发出警报,但却已收集了大量关于病人情绪和行为波动的宝贵信息。

companion使用界面

医生通过巡房只能了解病人的简单精神状态,但监测数据能做到的不止如此。作为布莱汉姆妇科医院的此次行为信息学与数字卫生项目的总负责,Ahern表示:“通过监测收集到的数据量极为庞大,能让我们非常有效地了解病人精神问题的本质。我们有信心通过这样的模式最终达成预防自杀的目标。”除了Companion以外,Ahern还在评估许多其他类型的数据流:比如通过可穿戴系统收集的生理指标、打电话和发短信的时间和频率等等,并将其也应用到自杀预防模型中、以提供符合个人情况的外部介入。

各类可穿戴系统

这么想想也的确很合理:毕竟手机通过摄像头、麦克风以及短信等各种传感器收集的数据,已经足以让人了解你了。甚至这些数据所展现出的你,比你自以为认识的自我还要深入。对你来说,少去了几次健身房、少打了几次电话回家,或者赖在床上没起来,都不是什么大事儿。但对于那个会无比敏锐地采集你所有不良习惯的机器来说,这些行为可能就是一盏盏“红灯”;随着你和机器相处的时间越长,其判断准确性也将日益增加。

在今天谈起这些事儿,可能还显得有些遥远。健康监测会不会带来个人隐私问题,恐怕也得留待日后的律师来仔细研究。但尽管如此,也请务必在你一目十行的间隙中偶尔停下来,看看你眼前的算法究竟想要告诉你些什么。指不定他们本身就是那些科幻片中才能看到的神奇技术呢。

Reference:https://www.wired.com/2017/03/artificial-intelligence-learning-predict-prevent-suicide/

最新评论

推荐文章

作者最新文章

你可能感兴趣的文章

Copyright Disclaimer: The copyright of contents (including texts, images, videos and audios) posted above belong to the User who shared or the third-party website which the User shared from. If you found your copyright have been infringed, please send a DMCA takedown notice to [email protected]. For more detail of the source, please click on the button "Read Original Post" below. For other communications, please send to [email protected].

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。

版权声明:以上内容为用户推荐收藏至CareerEngine平台,其内容(含文字、图片、视频、音频等)及知识版权均属用户或用户转发自的第三方网站,如涉嫌侵权,请通知[email protected]进行信息删除。如需查看信息来源,请点击“查看原文”。如需洽谈其它事宜,请联系[email protected]。